Искусственный интеллект упростил многие задачи в современном мире, но вместе с тем принес и немало проблем. Одной из самых острых стали многочисленные фейки, которые распространяются очень быстро, а проверить, написана ли правда, способны далеко не все люди. Во многих странах уже пришли к простому выводу: необходимо, чтобы работа ИИ была прозрачной, а люди могли доверять информации. Прозрачность, медиа-безопасность и цифровая безопасность особенно важны во времена высоких рисков боевых действий в Европе. Далее на berlinfuture.

За такую задачу взялись немецкие ученые. Доктор Вера Шмитт (Vera Schmitt) и ее исследовательская группа “XplaiNLP” сосредоточились на создании мощных проектов, среди которых – крупнейшая немецкоязычная платформа ИИ для выявления дезинформации. По словам доктора Шмитт, эти разработки помогают сразу отличить правду от лжи и делают информационное пространство более безопасным. Платформа работает открыто и понятно, чтобы пользователи видели, как анализируются данные.

Медиа-безопасность в мире ИИ

Цель своего научного исследования доктор Вера Шмитт из Берлинского технического университета (Technische Universität Berlin) объяснила просто: стремление помочь людям и машинам лучше понимать друг друга. Для этого команда и создает специальные интеллектуальные системы поддержки решений, которые помогают видеть правду и отличать ее от лжи. Работа предусматривает выявление дезинформации и разработку методов искусственного интеллекта, которые были бы понятны каждому. Тогда никто не потеряется в сложных алгоритмах.

Идею активно поддержал Центр производственных технологий Берлинского технического университета. Благодаря финансированию в более 4 миллионов евро, госпожа Шмитт смогла собрать команду из 24 специалистов, которые работали над разными инновационными проектами. Среди них – платформы “VeraXtract” и “News-polygraph”, которые помогают быстро проверять информацию и бороться с фейками.

Ученая рассказала журналистам, что с детства ее интересовали очень простые, но важные вопросы: что такое правда и как понять, соответствует ли реальность тому, что мы видим и слышим, реальность. Уже в 10 лет она читала философские книги, чтобы разобраться, как люди в разные времена договаривались между собой, что следует считать истиной. С годами эти вопросы не исчезли, а стали более серьезными. Сначала госпожа Вера изучала политологию, чтобы понять, как информация влияет на общество, а позже обратилась к науке о данных, где научилась проверять утверждения на фактах. Уже во время работы над докторской диссертацией эти интересы объединились в одну идею – создать исследовательскую группу “XplaiNLP”, которая будет системно изучать, как люди и машины могут вместе искать правду в сложном информационном мире.

Для медиа-безопасности и проверки фактов

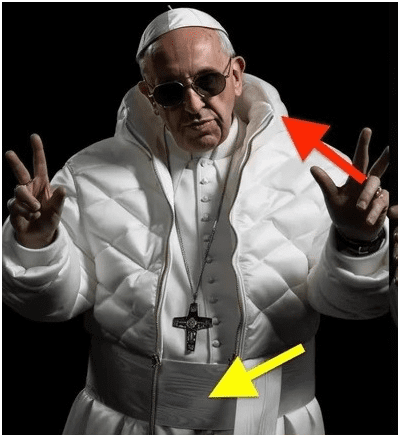

По мнению докторши, в будущем количество специально созданных дезинформационных кампаний будет только расти. Они станут нацеливать на конкретных людей, чтобы использовать их интересы и данные. Уже не редкость синтетические изображения, видео и аудиозаписи, которые называют “дипфейками” (Deepfakes).

Они еще больше усложняют понимание того, где правда, а где – ложь, поэтому медиа-безопасность и цифровая безопасность становятся для мира еще более важными. Со временем люди будут видеть мир через гиперперсонализациию в социальных сетях и так называемые “фильтрационные пузыри”. И здесь искусственный интеллект для медиа может помочь: он будет находить ложь, показывать правду и делать информационное пространство более понятным для всех.

Как работает платформа “VeraXtract”?

Эта разработка сосредоточена на поиске лживых историй (дезинформационных нарративов), которые создаются контентом с помощью искусственного интеллекта. Стоит вспомнить, что нарратив – это большая сложная история, которая часто объединяет несколько фрагментов лжи и различных теорий заговора и может распространяться через разные страны. Например, существует так называемый “нарратив замещения населения”, который утверждает, будто тайная элита использует миграцию, чтобы заменить коренных жителей.

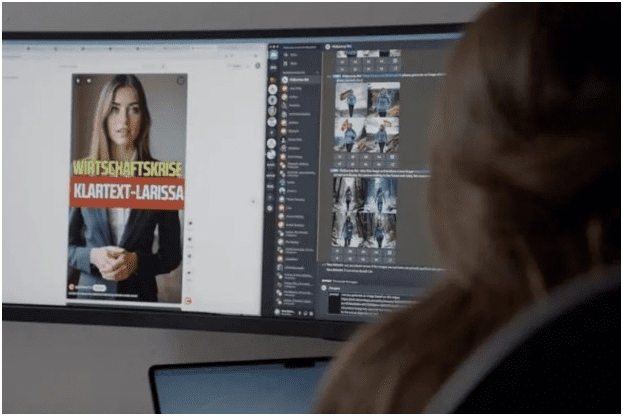

С помощью инструментов искусственного интеллекта программа “VeraXtract” способна искать такие истории и отслеживать, где они распространяются. Команда создала специальный “Инструмент мониторинга нарративов”, который помогает журналистам и исследователям лучше понимать ложные утверждения и видеть, в каком контексте они появляются. Например, этот инструмент можно установить, как плагин в браузере, чтобы проверять заявления в социальных сетях и определять, относятся ли они к дезинформационной истории.

Против дезинформации в цифровом мире

Искусственный интеллект объясняет, почему такие заявления могут создавать проблемы, и приводит доказательства в подтверждение своей оценки. Кроме того, ИИ способен подстраивать свои объяснения под пользователя, чтобы ему было легче понять, что происходит. Он также растолковывает, почему информация может вводить в заблуждение, учит распознавать фейки.

В долгосрочной перспективе команда “VeraXtract” видит создание большой базы проведенных проверок, фактов и структур дезинформационных историй. Она станет основой для объяснений и поможет проводить еще более глубокий анализ новых фейков и нарративов. Благодаря такой работе, платформа поможет сделать общество более сильным и устойчивым к дезинформации, чтобы люди научились отличать правду от лжи в медиа.

Проект “News-polygraph” – проверка фактов в реальном времени

В этом проекте речь идет о специальной компьютерной программе, которая умеет находить дезинформацию. А также – читать тексты, слушать аудио, смотреть изображения и видео и различать, что из этого может быть ложью. Доктор Вира Шмитт объяснила, что программа способна:

- помочь журналистам распознавать фейки;

- защитить людей от лживых новостей.

“News-polygraph” уже заявила о себе, как крупнейшая немецкоязычная платформа искусственного интеллекта для поиска дезинформации. Команду этого проекта финансирует Федеральное министерство исследований, технологий и космоса (Bundesministerium für Forschung, Technologie und Raumfahrt, BMFTR) через программу “RUBIN – Региональные предпринимательские альянсы для инноваций” (RUBIN – Regionale Unternehmensallianzen für Innovationen). Разработчики объяснили, что главная проблема дезинформации заключается в том, что люди видят и читают такие новости еще до проверки фактов. Это уже психологический аспект: ложь остается в памяти, и даже прочитанная позже правда уже не в состоянии вытеснить первое впечатление. Поэтому нужен шаг на опережение.

Почему проверка фактов должна быть в реальном времени?

По мнению ученой, оптимальным выходом была бы программа, которая бы находила ложные новости сразу, пока они еще не распространились, и не давала бы им разлетаться. Для этого нужны специальные компьютерные разработки на основе искусственного интеллекта, которые быстро проверяют, является ли новость правдивой. Например, плагин для браузера, который показывает в реальном времени, является ли то, что читаешь в интернете, правдой. В современном мире новости распространяются очень быстро на многих сайтах, поэтому такие инструменты крайне необходимы.

Искусственный интеллект может помогать людям общаться и понимать друг друга, даже если их взгляды и позиции не совпадают. Это как Netflix, который предлагает сериалы на основе того, что люди обычно смотрят, но иногда показывает новые и неожиданные фильмы. Так же ИИ способен демонстрировать новые мысли, темы или идеи, которые помогают видеть мир с разных позиций. Это снижает предвзятость и помогает лучше воспринимать информацию.

Немецкий ИИ в борьбе с дезинформацией

Доктор Вера Шмитт убеждена, что реализовать дальновидные планы реально, если будет больше средств на исследования и сформируется команда представителей разных сфер. Ведь немало проектов современные специалисты разрабатывают обособленно, без связи друг с другом, и это расходует ценные ресурсы. Если же объединить знания людей из разных областей и работать вместе, можно создавать лучшие и более новые способы борьбы с ложными новостями.

Проекты такого масштаба, которые предлагает “XplaiNLP”, важны не только для Германии, но и для всего мира. Они помогают быстро находить искаженную информацию и проверять факты, чтобы люди могли больше доверять новостям и медиа. Для Германии это гарантирует более безопасную цифровую среду, где легче обсуждать важные вопросы без фейков. Для мира – это доказательство того, что ИИ способен помогать людям не только лучше понимать друг друга, но и быстрее реагировать на проблемы. И не только с дезинформацией, но и с проверкой медицинских данных или решением юридических вопросов. Такой подход сделает работу с информацией более понятной и простой для всех, что является очень важным шагом на пути прогресса.

Источники: