Die Künstliche Intelligenz hat viele Aufgaben in der modernen Welt vereinfacht, aber gleichzeitig auch zahlreiche Probleme mit sich gebracht. Eines der akutesten Probleme ist die Verbreitung von Fakes, die sich rasrasend schnell verbreiten, während nur wenige Menschen in der Lage sind, den Wahrheitsgehalt zu prüfen. In vielen Ländern ist man bereits zu dem einfachen Schluss gekommen: Die Arbeit der KI muss transparent sein, damit die Menschen der Information vertrauen können. Mediensicherheit und digitale Sicherheit sind in Zeiten hoher Risiken durch kriegerische Auseinandersetzungen in Europa besonders wichtig. Mehr dazu auf berlinfuture.

Deutsche Wissenschaftler haben sich dieser Aufgabe angenommen. Dr. Vera Schmitt und ihre Forschungsgruppe „XplaiNLP“ konzentrieren sich auf die Erstellung leistungsstarker Projekte, darunter die größte deutschsprachige KI-Plattform zur Erkennung von Desinformation. Laut Dr. Schmitt helfen diese Entwicklungen dabei, Wahrheit sofort von Lüge zu unterscheiden und den Informationsraum sicherer zu machen. Die Plattform arbeitet offen und verständlich, damit die Nutzer sehen können, wie die Daten analysiert werden.

Mediensicherheit in der Welt der KI

Das Ziel ihrer wissenschaftlichen Forschung erklärt Dr. Vera Schmitt von der Technischen Universität Berlin ganz einfach: das Streben danach, Menschen und Maschinen zu helfen, einander besser zu verstehen. Zu diesem Zweck entwickelt das Team spezielle intelligente Entscheidungsunterstützungssysteme, die helfen, die Wahrheit zu erkennen und sie von Lügen zu unterscheiden. Die Arbeit umfasst die Erkennung von Desinformation sowie die Entwicklung von Methoden der Künstlichen Intelligenz, die für jeden verständlich sind. So verliert sich niemand in komplexen Algorithmen.

Die Idee wurde vom Produktionstechnischen Zentrum der Technischen Universität Berlin aktiv unterstützt. Dank einer Förderung von über 4 Millionen Euro konnte Frau Schmitt ein Team von 24 Experten zusammenstellen, die an mehreren innovativen Projekten arbeiteten. Dazu gehören die Plattformen „VeraXtract“ und „News-polygraph“, die helfen, Informationen schnell zu überprüfen und Fakes zu bekämpfen.

Die Wissenschaftlerin erzählte Journalisten, dass sie sich schon als Kind für sehr einfache, aber wichtige Fragen interessierte: Was ist die Wahrheit und wie erkennt man, ob das, was wir sehen und hören, der Realität entspricht. Bereits im Alter von 10 Jahren las sie philosophische Bücher, um zu verstehen, wie sich Menschen zu verschiedenen Zeiten darauf einigten, was als Wahrheit gelten soll. Mit den Jahren verschwanden diese Fragen nicht, sondern wurden ernsthafter. Zunächst studierte Frau Vera Politikwissenschaft, um zu verstehen, wie Informationen die Gesellschaft beeinflussen, und wandte sich später den Datenwissenschaften zu, wo sie lernte, Behauptungen anhand von Fakten zu prüfen. Während der Arbeit an ihrer Dissertation vereinten sich diese Interessen zu einer Idee – der Gründung der Forschungsgruppe „XplaiNLP“, die systematisch untersucht, wie Menschen und Maschinen gemeinsam im komplexen Informationsraum nach der Wahrheit suchen können.

Für Mediensicherheit und Faktenprüfung

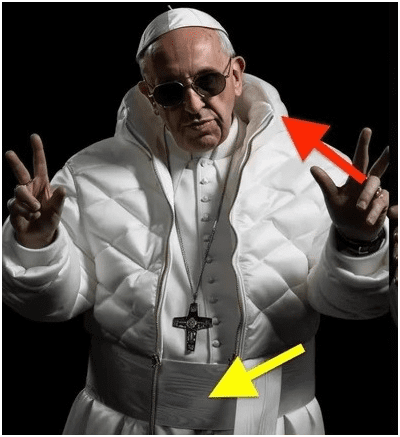

Nach Ansicht der Doktorin wird die Zahl der gezielt erstellten Desinformationskampagnen in Zukunft weiter zunehmen. Diese werden auf bestimmte Personen zugeschnitten sein, um deren Interessen und Daten auszunutzen. Synthetische Bilder, Videos und Audioaufnahmen, sogenannte „Deepfakes“, sind bereits keine Seltenheit mehr.

Sie erschweren das Verständnis darüber, was wahr und was gelogen ist, noch weiter, weshalb Mediensicherheit und digitale Sicherheit für die Welt immer wichtiger werden. Mit der Zeit werden die Menschen die Welt durch Hyperpersonalisierung in sozialen Netzwerken und sogenannte „Filterblasen“ wahrnehmen. Hier kann KI für Medien helfen: Sie findet Lügen, zeigt die Wahrheit auf und macht den Informationsraum für alle verständlicher.

Wie funktioniert die Plattform „VeraXtract“?

Diese Entwicklung konzentriert sich auf die Suche nach verlogenen Geschichten (Desinformationsnarrativen), die Inhalte mithilfe von Künstlicher Intelligenz erstellen. Es ist erwähnenswert, dass ein Narrativ eine große, komplexe Geschichte ist, die oft mehrere Fragmente von Lügen und verschiedenen Verschwörungstheorien kombiniert und über verschiedene Länder verbreitet werden kann. Ein Beispiel ist das sogenannte Narrativ vom „Bevölkerungsaustausch“, das behauptet, eine geheime Elite nutze Migration, um die einheimische Bevölkerung zu ersetzen.

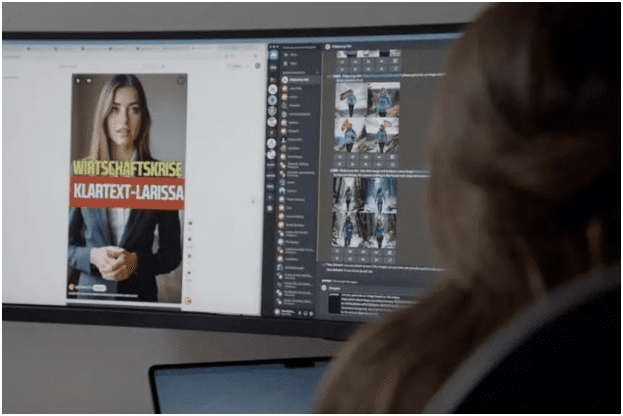

Mithilfe von KI-Tools ist das Programm „VeraXtract“ in der Lage, nach solchen Geschichten zu suchen und zu verfolgen, wo sie verbreitet werden. Das Team hat ein spezielles „Narrativ-Monitoring-Tool“ entwickelt, das Journalisten und Forschern helfen wird, unwahre Behauptungen besser zu verstehen und zu sehen, in welchem Kontext sie auftauchen. Dieses Tool kann zum Beispiel als Browser-Plugin installiert werden, um Aussagen in sozialen Netzwerken daraufhin zu prüfen, ob sie zu einer Desinformationsgeschichte gehören.

Gegen Desinformation in der digitalen Welt

Die Künstliche Intelligenz erklärt, warum solche Aussagen Probleme verursachen können, und führt Beweise zur Untermauerung ihrer Einschätzung an. Darüber hinaus kann die KI ihre Erklärungen an den Nutzer anpassen, um das Verständnis der Vorgänge zu erleichtern. Zudem erläutert sie, warum Informationen irreführend sein können, und lehrt, Fakes zu erkennen.

Langfristig sieht das Team von „VeraXtract“ die Schaffung einer großen Datenbank mit durchgeführten Prüfungen, Fakten und Strukturen von Desinformationsgeschichten vor. Diese wird als Grundlage für Erklärungen dienen und helfen, noch tiefere Analysen neuer Fakes und Narrative durchzuführen. Dank dieser Arbeit wird die Plattform die Gesellschaft stärken und widerstandsfähiger gegen Desinformation machen, damit die Menschen lernen, Wahrheit von Lüge in den Medien zu unterscheiden.

Projekt „News-polygraph“ – Faktenprüfung in Echtzeit

In diesem Projekt geht es um ein spezielles Computerprogramm, das Desinformation finden kann. Zudem kann es Texte lesen, Audioaufnahmen hören sowie Bilder und Videos betrachten, um zu unterscheiden, was davon eine Lüge sein könnte. Dr. Vera Schmitt erklärte, dass das Programm Journalisten helfen kann, Fakes zu erkennen und Menschen vor verlogenen Nachrichten zu schützen. „News-polygraph“ hat sich bereits als größte deutschsprachige KI-Plattform zur Suche nach Desinformation etabliert.

Das Team dieses Projekts wird vom Bundesministerium für Bildung und Forschung (BMBF) über das Programm „RUBIN – Regionale Unternehmensallianzen für Innovationen“ finanziert. Die Entwickler erklärten, dass das Hauptproblem bei Desinformation darin besteht, dass Menschen solche Nachrichten bereits sehen und lesen, bevor eine Faktenprüfung stattfindet. Dies ist ein psychologischer Aspekt: Die Lüge bleibt im Gedächtnis, und selbst die später gelesene Wahrheit ist oft nicht mehr in der Lage, den ersten Eindruck zu verdrängen. Daher ist ein präventiver Schritt erforderlich.

Warum muss die Faktenprüfung in Echtzeit erfolgen?

Nach Ansicht der Wissenschaftlerin wäre ein Programm, das verlogene Nachrichten sofort findet, bevor sie sich verbreiten, und deren Ausbreitung verhindert, der optimale Ausweg. Dazu werden spezielle Computerentwicklungen auf Basis von Künstlicher Intelligenz benötigt, die schnell prüfen, ob eine Nachricht wahr ist. Zum Beispiel ein Browser-Plugin, das in Echtzeit anzeigt, ob das, was man im Internet liest, der Wahrheit entspricht. In der modernen Welt verbreiten sich Nachrichten sehr schnell und auf vielen Websites, weshalb solche Werkzeuge dringend erforderlich sind.

Künstliche Intelligenz kann Menschen helfen zu kommunizieren und einander zu verstehen, selbst wenn ihre Ansichten und Positionen nicht übereinstimmen. Es ist wie bei Netflix, das Serien basierend auf dem vorschlägt, was Menschen üblicherweise schauen, aber manchmal auch neue und unerwartete Filme zeigt. Ebenso kann KI neue Gedanken, Themen oder Ideen aufzeigen, die helfen, die Welt aus verschiedenen Positionen zu sehen. Dies verringert Vorurteile und hilft, Informationen besser aufzunehmen.

Deutsche KI im Kampf gegen Desinformation

Dr. Vera Schmitt ist überzeugt, dass die Umsetzung weitreichender Pläne realistisch ist, wenn mehr Mittel für die Forschung bereitstehen und sich ein Team aus Vertretern verschiedener Branchen bildet. Denn viele Projekte entwickeln moderne Fachleute isoliert voneinander, ohne Verbindung untereinander, was wertvolle Ressourcen verschwendet. Wenn man jedoch das Wissen von Menschen aus verschiedenen Bereichen bündelt und zusammenarbeitet, können bessere und neuere Wege zur Bekämpfung von Lügennachrichten geschaffen werden.

Projekte dieses Ausmaßes, wie sie „XplaiNLP“ vorschlägt, sind nicht nur für Deutschland, sondern für die ganze Welt wichtig. Sie helfen, manipulierte Informationen schnell zu finden und Fakten zu prüfen, damit Menschen Nachrichten und Medien wieder mehr vertrauen können. Für Deutschland garantiert dies eine sicherere digitale Umgebung, in der wichtige Fragen ohne Fakes diskutiert werden können. Für die Welt ist es der Beweis, dass KI in der Lage ist, Menschen nicht nur zu einer besseren Verständigung zu verhelfen, sondern auch schneller auf Probleme zu reagieren. Und das nicht nur bei Desinformation, sondern auch bei der Überprüfung medizinischer Daten oder der Lösung juristischer Probleme. Ein solcher Ansatz wird die Arbeit mit Informationen für alle verständlicher und einfacher machen, was ein sehr wichtiger Schritt auf dem Weg des Fortschritts ist.

Quellen: